Voici une scène scolaire classique de notre jeunesse :

Lundi matin 9h, contrôle de maths, Pierre, le boss en maths « gratte » sa copie sans aucune difficulté. Paul, son voisin, plutôt nul en maths, essaye de copier, tant bien que mal sur Pierre.

Jacques, qui est à coté de Paul, et qui n’est pas meilleur que lui, jette un œil furtif sur les réponses de Pierre et les posent sur sa copie.

Vendredi 14h, le prof de maths rend les copies « Pierre, bravo 18/20. Paul et Jacques 0/20, vous croyez que je n’ai pas vu que vous aviez copié sur Pierre ? »

Vous allez me dire « mais quel lien avec le sujet de l’IA générative, et son éventuel déclin ? ».

Pour cela, il faut comprendre comment fonctionne l’IA générative. Avant de pouvoir répondre à toutes vos questions, il est impératif, que l’IA en question « ingurgite » des tonnes et des tonnes de données, comme par exemple, la copie de Pierre.

Plus les données sont variées, nombreuses et qualitatives, plus les réponses seront pertinentes.

Par exemple, avant de pouvoir demander à une IA générative de créer une image d’une scène bucolique, avec une vache et un âne à la « Claude Monet », il faudra que l’IA ingurgite des « tonnes » d’images de campagnes, de vaches, d’ânes et surtout tous les tableaux de « Claude Monet ».

Heureusement, aujourd’hui le web est une source gratuite et sans fin de données, d’images, de vidéos. Grace à ce qu’on appelle dans le jargon technique, un « crawler », il est possible de capturer automatiquement les données du web, puis de les filtrer pour ne garder que celles qu’on estime « qualitatives » (par exemple on ne veut pas de la copie de Paul et Jacques)

Mais maintenant, projetons-nous dans un futur proche. En 2030, L’IA générative sera notre outil quotidien, et il est fort probable qu’une très grande majorité d’entre nous, la sollicitera pour lui demander de générer à notre place des rapports, des images d’illustrations, de répondre à nos messages, de coder des applications, …

Petit à petit, disparaitront les métiers de la création « humaine » et nos médias seront submergés de créations « synthétiques ».

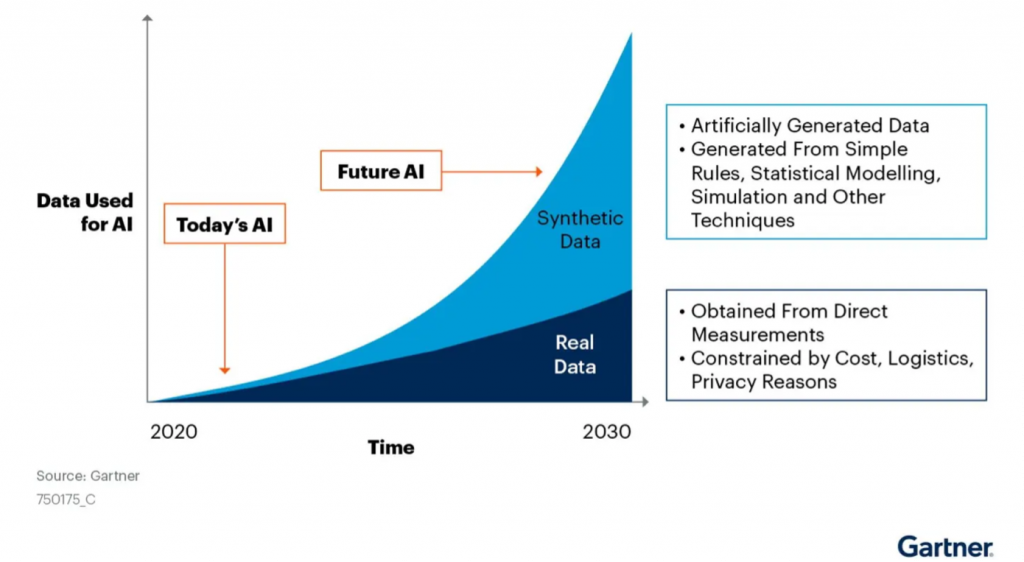

D’après une étude Gartner, 60% des contenus en 2030 seront synthétiques, contre 1% en 2021.

En 2025, on peut s’accorder sur le fait que, quelque soit le modèle LLM utilisé, les résultats obtenus sont impressionnants, et la seule limite est l’imagination du « prompteur » de questions.

Nous pouvons anticiper, qu’en 2030, les IA génératives devront probablement se « nourrir » de 60% de données qui ont été créés elles même par des IA.

Cela aura 2 conséquences :

- Sachant, que les réponses des IA génératives, ne sont jamais parfaitement alignées aux demandes, elles vont créer parfois des « hallucinations » ou des « biais » (par exemple un mouton avec 5 pattes). Comme nous l’avions vu avec le devoir de Paul, qui a essayé de reproduire exactement la copie de Pierre, mais comme Pierre n’est pas un expert en maths, il a introduit à son insu quelques erreurs. Après plusieurs itérations de « crawling » des données sur le Web dont celles partiellement erronées, ces modèles LLM, finiront par amplifier les biais, jusqu’à donner des réponses totalement fausses.

- L’IA générative, ne fait qu’assembler, des minuscules morceaux ce qu’elle ingurgite (nommer token), sans nouvelle création, l’IA finira tournera en boucle.

Quand, on y pense, la création n’est pas un éternellement recommencement. Prenons par exemple, la célèbre Gabrielle Chanel dit « Coco Chanel », qui va créer en 1954 ses fameux tailleurs, concept totalement disruptif et même à contre-courant pour l’époque.

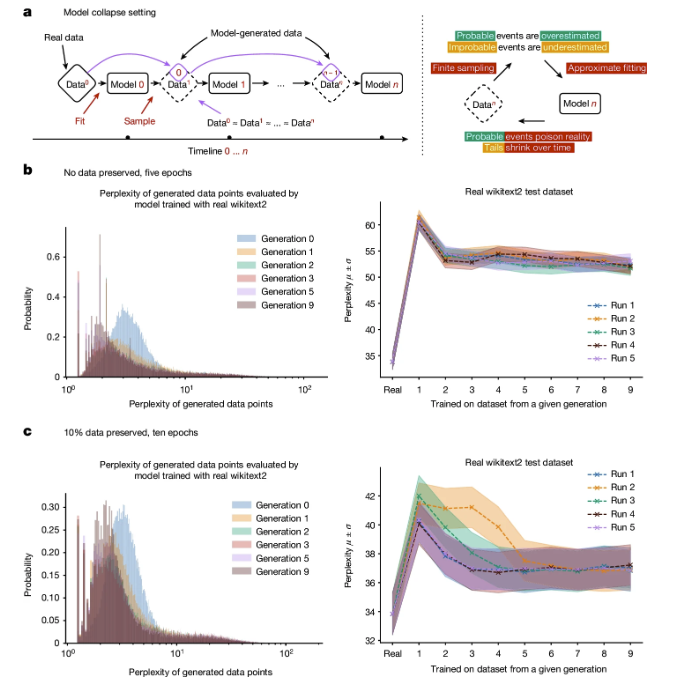

Cette problématique, que je nommerai « l’effet miroir » (de l’effet d’une personne qui se film devant un miroir), ou que d’autres appellent le « récursive effect » a fait l’objet d’une étude sérieuse de chercheurs de l’université d’Oxford et de Cambridge.

Dans cette étude, publiée dans le magazine « Nature », ils ont examiné le comportement un LLM (comme ChatGPT), qui ingurgiterait récursivement des données sans discernement, qu’elles soient synthétiques ou non. Après plusieurs itérations, ils constatent des biais non réversibles, et qu’à long terme, ces biais pourraient entrainer l’effondrement du système

(source https://www.nature.com/articles/s41586-024-07566-y).

Bien sûr, ces études sont des projections sur les modèles LLM existants, nous ne savons pas comment ceux-ci évolueront d’ici 2030 et quel en sera le degré d’adoption.

Nous devons dès aujourd’hui prendre conscience que l’IA générative n’est qu’un outil qui permet de nous assister mais qui ne doit pas remplacer la « créativité d’origine humaine » si nous voulons préserver notre futur.

© BRAIN CONCEPT 2025

Si vous avez aimé cet article abonnez-vous, d’autres articles seront prochainement publiés.

Pour information, cet article a été écrit par la méthode traditionnelle, seulement quelques images ont été générées par de l’IA à des fins d’illustration.